由于容器的特性,在容器重新创建后日志会废弃掉,如何通过持久化和中心化的处理容器日志变成一个棘手的问题,如何通过 Elastic Stack 进行一站式的数据采集,数据清洗,数据落地,数据可视化,让数据发挥真正的价值呢?

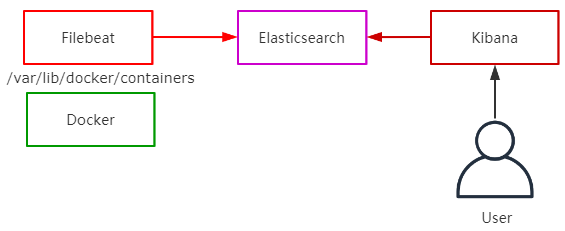

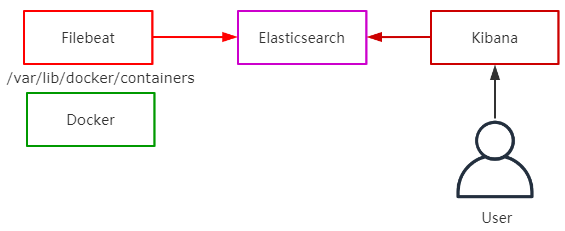

涉及到 Elastic Stack 中 Filebeat 是用于采集 Docker 相关的日志, Elasticsearch 是用于对于数据落地存储和搜索的引擎, Kibana 是用于对数据可视化的工具。

在 Docker 中容器的日志是存储在/var/lib/docker/containers/ 目录下的,目录下的每一个文件夹为容器ID,容器ID目录下的 log 类型文件则为容器的日志文件。

以 Docker 环境下为例

docker有什么用、Filebeat

启动 Filebeat 容器,并且将存储卷映射到数据目录docker run -d --name filebeat --user=root -v /var/lib/docker/containers:/var/lib/docker/containers elastic/filebeat:7.9.2

进入容器修改配置docker exec -it filebeat /bin/bash

修改配置,添加 Elasticsearch 和 Kibana 的主机vi filebeat.yml

filebeat.config:modules:path: ${path.config}/modules.d/*.ymlreload.enabled: falseprocessors:- add_cloud_metadata: ~- add_docker_metadata: ~filebeat.inputs:- type: dockercontainers:path: "/var/lib/docker/containers"json.keys_under_root: trueids:- "*"output.elasticsearch:hosts: 'elasticsearch:9200'username: "elastic"password: "xxx"

setup.kibana:host: "kibana:5601"

设置 Filebeat 创建 Kibana上的 Index Pattern 和 Dashboardfilebeat setup

重启 Filebeat 生效配置docker restart filebeat

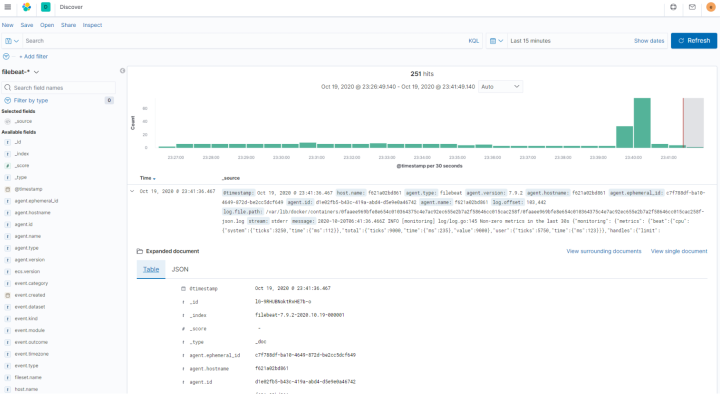

查看docker容器日志、通过 Kibana 中的 Discover 功能

版权声明:本站所有资料均为网友推荐收集整理而来,仅供学习和研究交流使用。

工作时间:8:00-18:00

客服电话

电子邮件

admin@qq.com

扫码二维码

获取最新动态